1 | 主讲人:杨迅(通力律师事务所律师) |

一、人工智能的发展和应用

人工智能分为三个发展阶段:计算智能、感知智能、认知智能。

- 计算智能,即快速计算和记忆存储能力。著名的例子如:1)1996年IBM的深蓝计算机战胜了当时的国际象棋冠军卡斯帕罗夫;2)AlphaGo在围棋方面也取得了胜利。

- 感知智能,即视觉、听觉、触觉等感知能力。激光雷达、微波雷达和红外雷达等机器可以主动感知,目前也已经出现了Big Dog感知机器人、自动驾驶汽车等。

- 认知智能,即能够真正地理解自己所在进行的工作。Chatgpt目前尚不具备,但在未来,认知智能将会是AI的重要发展方向。

目前,人工智能已经被广泛地使用于游戏中:

NPC:通过AI让NPC能够完成复杂的互动,并拥有“记忆”。如:Inworld平台(融资5000万估值5亿美元,智能助手的先驱用AI让游戏NPC拥有情感和记忆)。另外,《逆水寒》中的很多NPC也调用了大语言模型作为支持。此处引发的问题是:内容审核责任分配问题。换言之,当NPC基于和玩家的互动说出敏感内容时,游戏公司负有何种责任?

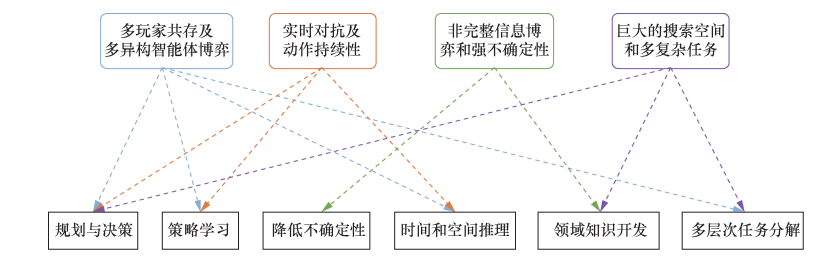

游戏智能体:“AI智能体(AIagent)”这一概念的出现是为了弥补Chatgpt作为通用大模型的短板,它是一种能够感知环境、进行决策和执行动作的智能实体。其中,作用于游戏的便是“游戏智能体”。它们拥有自主性和自适应性,可以依靠AI赋予的能力完成特定任务,并在此过程中不断对自我进行完善和改进。不同的AI智能体之间也可以进行交互,从而共同完成某些工作。

程序化内容生成(Procedural Content Generation):PCG是基于有限或间接的用户输入的游戏内容生成算法,PCG可以自己创造内容,也可以和人类玩家或设计师共同创造。

《暗黑破坏神》:生成地图、道具和怪物;

《孢子》:玩家创建的生物填充整个星系;

《文明4》:随机地图;

《我的世界》:生成整个世界和内容;

《洞穴探险》:2D平台roguelike游戏;

《翼飞冲天》:2D手游,生成地形和纹理。

二、人工智能开发和应用的挑战

- 隐私:人工智能技术的应用极大地扩展了个人信息收集的场景、范围和数量,提出了新的问题。例如,用户在和NPC对话时不小心透露的个人信息是否也需要游戏公司来处理?

- 信息安全:遵守《互联网个人信息安全保护指南》等规定。

- 知识产权:科学家、法学家围绕人工智能生成物是否具有产权(版权或专利权)等问题展开了激烈的争论。

- 可靠性和责任分配:人身伤害、算法偏见等违法或者违反伦理道德的行为对应的责任划分很模糊,不同的领域出现的问题不同。

三、人工智能的隐私风险

(一)输入

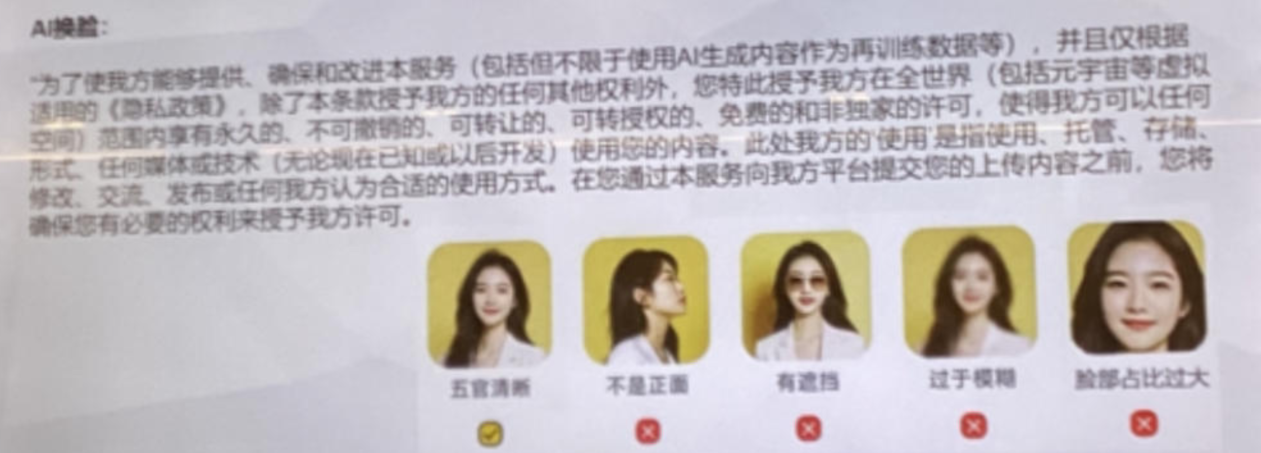

- 必要、最小:企业自行收集数据时,应当遵循最小必要原则,只能基于特定用途进行收集。例如,AI写真app采集用户的肖像权是为了产出产品,则不能用于公司AI的训练。

- 告知、透明、同意:在收集前必须明确告知收集信息的具体规则、收集范围及使用用途,获得相关信息主体在明确知情前提下的合法授权。不建议使用“默认勾选同意”“注册即授权”等非明示授权方式。

- 人工智能处理的拒绝权:《个人信息保护法》第24条第3款明确了完全自动化决策拒绝权的请求权基础。

- 游戏公司使用AI进行打击外挂工作时,是否给被判定违规的用户提供了申诉渠道?

- 应用市场是否给用户提供了“不接受大数据精准推送”的选项?

- 游戏公司通过玩游戏的规律性、频率等判断玩家是否是未成年⼈时,是否提供了申诉渠道/不接受此种判断的选择权?

(二)输出

1. AI输出的内容存在侵权问题,由谁负责?

魔音工坊案(全国首例“AI声音侵权案”)

他人利用原告声音的配音作品在社交平台上广泛流传。经溯源,发现上述声音作品中的声音来自被告运营的“魔音工坊”App。北京小问智能科技有限公司认为,其App中的声音产品有合法来源,来自微软(中国)有限公司。微软(中国)有限公司称其使用的声音来源于中广影音(北京)文化传媒有限公司。中广影音(北京)文化传媒有限公司认为其与原告有过合作,约定经原告录制形成的作品著作权归属其所有。该案目前(23年12月)尚在审理中,可以关注后续动态

从理论而言,原告给中广影音的授权停留在著作权层面,和其声音的全部元素的授权不同,应当认为构成侵权。AI训练的著作权侵权

AI图形编辑公司需要对AI进行训练,训练的内容来自于公有领域的作品。

我国法律尚未规定AI可以使⽤已经发表的作品用于训练:《著作权法》没有合适的“合理使用”条文;不能基于“科研需要”使用,因为那是《专利法》项下的条文。

但是,严格来说,如果没有输出侵权作品,而只是使用公开的图片进行训练,也不能算是真正的侵权,毕竟还没有造成真正的危害,也没有“替代性使用”。中国采用的侵权判断偏列举式(或“接触可能性+实质性相似”),灵活性不高;美国采用“四分法”判断是否成立侵权,灵活性更高。

总之,上述问题目前处于“灰色地带”,大部分著作权人不知情或也没有实际追究。

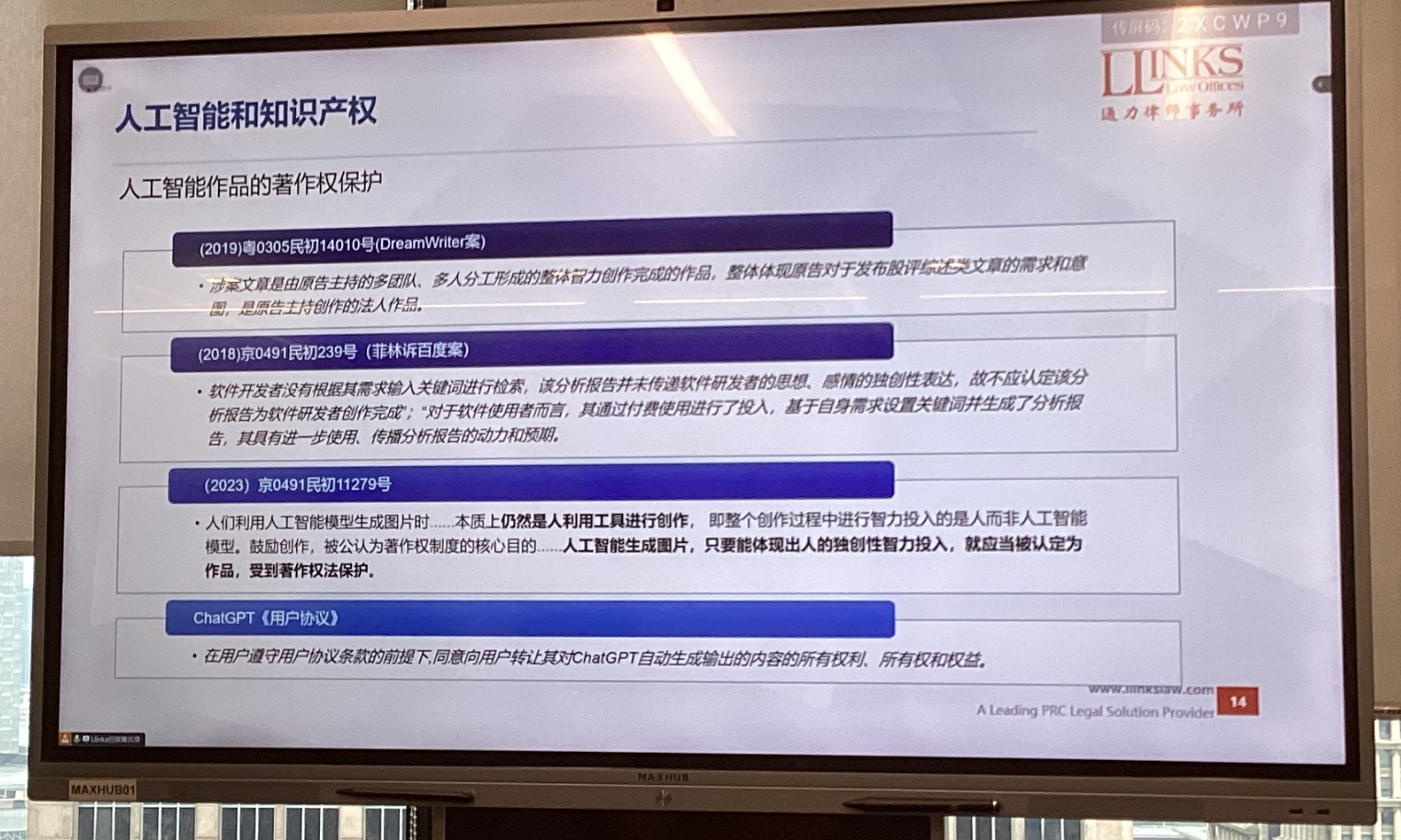

2. 什么情况下是工具,何时反映创作者的意志?

上图中,左边的圆环统计图是用AI生成的,右边的女孩图像也是用AI生成的。

本案中,从涉案图片本身来看,体现出了与在先作品存在可以识别的差异性。从涉案图片生成过程来看,一方面,虽然原告并没有动笔去画具体的线条,甚至也没有百分之百的告知Stable Diffusion模型怎样去画出具体的线条和色彩,可以说,构成涉案图片的线条和色彩基本上是Stable Diffusion模型“画”的,这与人们之前使用画笔、绘图软件去画图有很大的不同。但是,原告对于人物及其呈现方式等画面元素通过提示词进行了设计,对于画面布局构图等通过参数进行了设置,体现了原告的选择和安排。另一方面,原告通过输入提示词、设置相关参数,获得了第一张图片后,其继续增加提示词、修改参数,不断调整修正,最终获得了涉案图片,这一调整修正过程亦体现了原告的审美选择和个性判断。在庭审中,原告通过变更个别提示词或者变更个别参数,生成了不同的图片,可以看出,利用该模型进行创作,不同的人可以自行输入新的提示词、设置新的参数,生成不同的内容。因此,涉案图片并非“机械性智力成果”。在无相反证据的情况下,可以认定涉案图片由原告独立完成,体现出了原告的个性化表达。综上,涉案图片具备“独创性”要件。

在上图中的Dream Writer案件中,法院认为:

- 著作权法所称创作,是指直接产生文学、艺术和科学作品的智力活动。据此,具体认定是否属于创作行为时应当考虑该行为是否属于一种智力活动以及该行为与作品的特定表现形式之间是否具有直接的联系。

- 由于创作工具的技术特征,涉案文章的创作过程不仅包括Dreamwriter软件自动运行的过程,也包括主创团队相关人员在事前对Dreamwriter所作的相关选择与安排。

- 本案中原告主创团队在数据输入、触发条件设定、模板和语料风格的取舍上的安排与选择(数据类型的输入与数据格式的处理、触发条件的设定、文章框架模板的选择和语料的设定、智能校验算法模型的训练等;收集素材、决定表达的主题、写作的风格以及具体的语句形式的行为),属于著作权法意义上的智力活动。

- 该智力活动与涉案文章的生成之间有足以被认定为“直接产生”的联系。

这一推理过程值得深思。收集素材、设定触发条件以取舍模板与语料风格、决定主题的行为,属于设定与应用规则的行为,恐怕均难以满足“直接产生”的要求。如果视生成式AI为创作工具,那么这同样也是制作工具的行为。

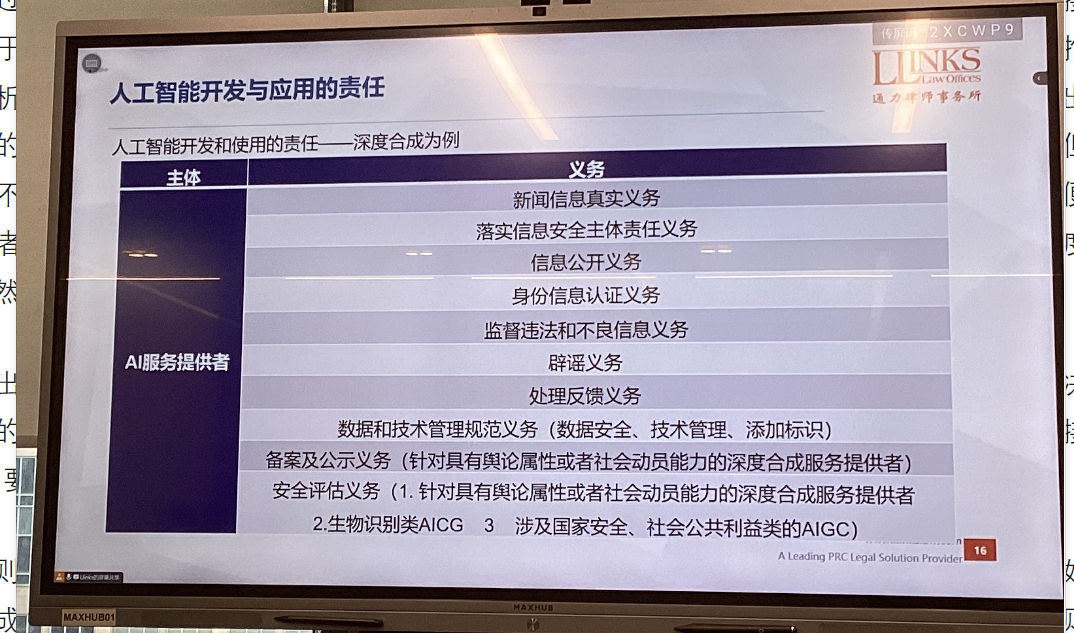

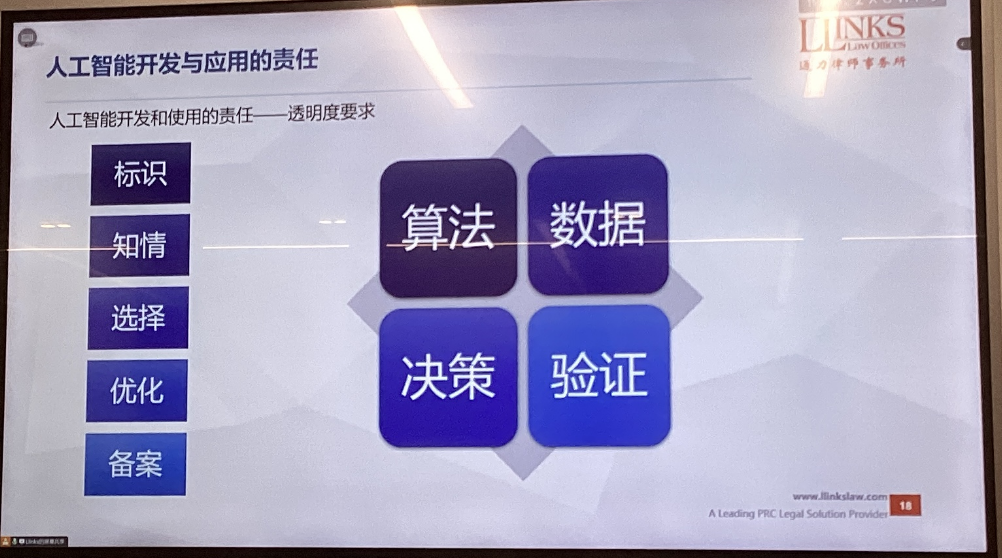

四、人工智能开发与应用的责任

人工智能存在着诸多系统性缺陷,如算法歧视、数据污染等,引发了与人工智能责任分配有关的问题。

上图简单概括了我国的部分规定,从表述来看,总体还比较模糊。

透明度是欧盟对人工智能系统的开发、部署和使用所倡导的核心价值之一。自监管人工智能的政策进程开始以来,所有相关文件包括人工智能高级别专家组截至2018年12月所发布的《可信人工智能伦理准则》(Ethics Guidelines for Trustworthy AI issued by the High-Level Expert Group on AI as of December 2018)、欧盟委员会于2020年2月发布的《人工智能白皮书》(White Paper on AI issued by the European Commission in February, 2020)、以及欧洲议会截至2020年10月所发布的《人工智能、机器人和相关技术的伦理问题框架》(European Parliament’s Framework of Ethical Aspects of AI, Rrobotics and Related Technologies as of October, 2020).

《人工智能法案》

第13条第1款

高风险人工智能系统的设计和开发应确保其操作足够透明, 使用户能够解释系统的输出并适当地使用它。

第52条第1款

供应商应确保旨在与自然人互动的人工智能系统的设计和开发能够 使自然人被告知他们正在与人工智能系统进行互动,如果从环境和使用背景中可以明显看出这一点,则不用如此。

从实践来看,透明度要求在AI领域中还没实现。一方面,技术开发者不希望公开自己的内容。另一方面,用户对是否透明似乎也并不关心。

我国作为判例法国家,在定义方面用语非常模糊,是为了保留灵活性。但是,这也给AI领域的参与者带来了政策风险,需要时刻注意动向。